今日李世乭-Alphago对决最后一局

①若在没有进行学习的情况下对决,会出现意外结果

②若出现问题是研究团队的责任,还是人工智能的责任?

③若没有庞大的数据库,人工智能实际上是无用之物

3月13日,李世乭九段首次战胜Alphago,这不仅是围棋史上极具价值的胜利,也给预测人工智能的未来提供了重要的启示。在之前举行的前三局中,Alphago展现了出众的能力,而在第4局比赛中,则显露出了一些自身的局限性,这也是人工智能技术的致命性弱点。这给我们在未来接受或应用人工智能时提出了三个需要思考的问题。

在第四局中,李九段下出绝妙的第78步棋后,Alphago接连下出“废棋”(奇怪的步数),对棋局失去控制。Alphago在第二局比赛中也曾下出几步奇怪的棋,但最终还是获得了胜利。因为看到过这个,解说员在其下出废棋后,小心解释并摇着头道“真奇怪”。本局比赛以Alphago的完败告终。这不仅是Alphago,也是此类人工智能都存在的决定性局限。

ALphago的系统仿造人类大脑构成,并输入了大量的数据,采取了计算机自己领悟规则的“机械学习”方式,因此Alphago才能像人类按照直觉一样下围棋。但这种方式具有致命的缺点,即,如果没有进行学习就进行对决,就会出现意外的结果。本次第四局比赛中正凸显了这一致命的缺点。仁荷大学金东根(音)教授(电子工程学)指出,“人工智能有可能经常出现这种不该有的失误”。

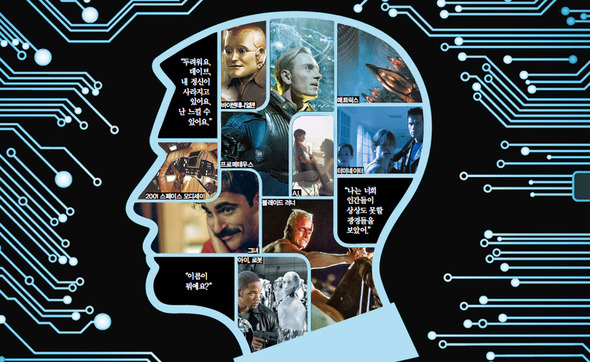

人工智能的这种局限性,在围棋等竞技中不会出现太大问题,但在其他领域,甚至有可能会引起生命威胁等严重问题。未来将正式应用人工智能的领域,如军事武器、医疗诊断、无人驾驶汽车等都是其中代表性例子。斯蒂芬•霍金等国际权威专家很久之前就警告过,不能在军事武器领域使用人工智能。谷歌目前正在进行实验的人工智能医疗诊断和无人驾驶汽车也都不能容忍一点点的意外失误。对此,被称为“Alphago之父”的谷歌Deep Mind首席执行官(CEO)戴密斯•哈萨比斯表示,“Alphago目前还只是试制品”。

第二个问题是责任划分。未来如果出现失误而引发事故,这个责任由谁承担呢?正如本次对决中所证实的,人们无意识中对于人工智能的独立性有很强的认可倾向。Alphago赢李世乭九段时,大部分媒体的报道并非“制造Alphago的谷歌研究团队完胜李世乭九段”,而是“人工智能完胜人类”。在Alphago输掉比赛时,报道也是“人类完胜”。由此来看,胜负的责任全在Alphago。

虽然围棋等竞技确实不会出现严重的问题,但如果人工智能在生命相关的领域出现失误,那么责任问题将引起一场大混乱。人工智能有自己学习的能力,因此应由人工智能承担责任呢,还是应由开发人工智能的研究团队承担责任呢?想要发展•普及人工智能技术,就先要解决这一法律、伦理上的问题。

最后一个问题在于,如果Alphago等人工智能并没有输入大量的“数据”,那么将成为无用之物。在记者会上,当被问到Alphago是否针对李世乭进行了特别训练时,哈萨比斯代表回答称,“如果没有数百万的数据,我们想做也做不了”。也就是说,如果李世乭九段的比赛记录还未有数据,就不可能进行针对性的训练。即,现在的人工智能技术只能在由数百万计算机数据堆积而成的领域,能够接触这种“大数据”的情况下,才能够得以利用。

权五圣 记者